De la mano de OmniTouch, Kinect de Microsoft ahora hace posible convertir cualquier superficie en una pantalla táctil. Investigadores han combinado un sensor Kinect con un picoproyector para ampliar las posibilidades de las pantallas interactivas.

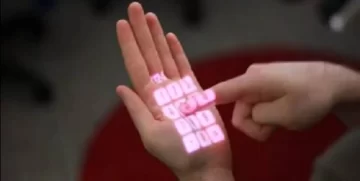

Este nuevo prototipo es capaz de transformar un bloc de notas en una netbook, una pared en una pantalla interactiva o tablet y la palma de la mano en una pantalla de teléfono inteligente. De hecho, investigadores de Microsoft y la Universidad Carnegie Mellon (EE.UU.) afirman que su nuevo dispositivo, que se coloca sobre el hombro y responde al nombre de OmniTouch, puede convertir cualquier superficie cercana en una pantalla táctil interactiva para un propósito específico.

OmniTouch funciona gracias a la unión de un proyector en miniatura y una cámara de profundidad por infrarrojos, similares a las que se usan en la consola de juegos Kinect de Microsoft, para crear un sistema con el que interactuar con dispositivos móviles como, por ejemplo, teléfonos inteligentes, explica su coinventor Chris Harrison, investigador de postgrado en el Instituto de Interacción Persona-Computadora de Carnegie Mellon en Pittsburgh, así como antiguo interno en prácticas en Microsoft Research. En lugar de usar pantallas, botones o teclas, el sistema analiza el entorno del usuario en busca de todas las superficies disponibles y proyecta una pantalla interactiva en una o varias de ellas.

OmniTouch lo hace automáticamente, utilizando la información de profundidad proporcionada por la cámara para crear un modelo 3D del entorno, afirma Harrison. La cámara obtiene información detallada acerca de la escena mediante la emisión de un haz de luz infrarroja con patrones y usando las reflexiones para el cálculo de las superficies que se encuentran en la habitación. Esto elimina la necesidad de usar marcadores de calibración externa. El sistema reconstruye el modelo de forma dinámica a medida que el usuario o la superficie se mueve -por ejemplo, la posición de la mano o el ángulo de orientación de un libro- por lo que el tamaño, forma y posición de estas proyecciones coinciden con los de las superficies de la pantalla improvisada, asegura Harrison.

El sistema también controla el entorno y busca cualquier objeto cilíndrico con más o menos el tamaño de un dedo para saber en qué momento el usuario está interactuando con la pantalla, una vez más, usando información de profundidad para determinar cuándo un dedo o varios entran en contacto con la superficie. Esto permite a los usuarios interactuar con superficies arbitrarias como lo harían con una pantalla táctil, indica Harrison. Del mismo modo, los objetos e iconos de las "pantallas" pueden ser movidos y pellizcados para desplazarse y hacer zoom, al igual que en una pantalla táctil tradicional. En una aplicación artística de demostración, por ejemplo, OmniTouch utiliza una pared o mesa cercana como lienzo y la palma de la mano del usuario como la paleta de colores.

Aunque la configuración en el hombro no es en absoluto práctica, según admite Hrvoje Benko, investigador del grupo de Investigación de Interacción Natural en Microsoft Research, Redmond (Washington), quien también trabajó en el proyecto junto con su colega Andrew Wilson, lo importante "no es el lugar en que se coloque sino sacar adelante esta idea de convertir cualquier superficie disponible en una superficie interactiva", afirma. Todos los componentes utilizados en OmniTouch se pueden adquirir fácilmente y cada vez se fabrican a un tamaño más pequeño. "No estamos tan lejos de convertirlo en un colgante o en algo que pueda ir adherido a las gafas", afirma Benko.

Fuente: MIT Technology Review