Anthropic, empresa pionera en el campo de la IA, anunció la contratación de un investigador especialista en “bienestar en IA”. La incorporación de este experto subraya la creciente necesidad de que las IA sean desarrolladas de manera responsable y ética, especialmente ante la posibilidad de que puedan adquirir conciencia.

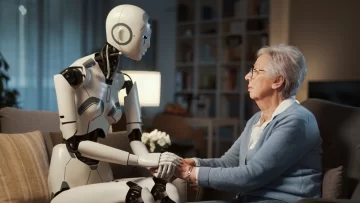

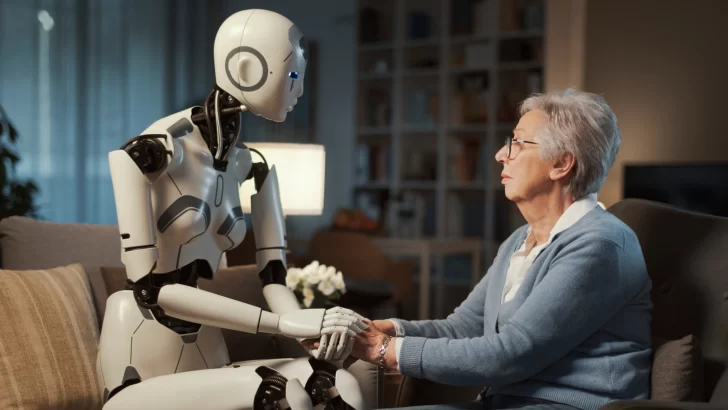

La inteligencia artificial (IA) ha transformado radicalmente el panorama global, impactando en sectores como la economía, la política, la cultura y la educación. La IA no solo ha potenciado la productividad y la innovación tecnológica, sino que también ha influido en la manera en que los seres humanos perciben y se relacionan con su entorno, llevándolos a una constante adaptación. Sin embargo, surge una pregunta aún más profunda: ¿qué pasaría si la IA llegara a desarrollar conciencia? Este hipotético escenario abriría nuevos dilemas éticos y sociales, y plantea la necesidad de prepararse para un futuro en el que esta posibilidad sea real.

“Anthropic, una de las empresas líderes en el desarrollo de inteligencia artificial avanzada, ha comenzado a explorar esta posibilidad con una perspectiva ética. Fundada por los ex ejecutivos de OpenAI, Darío y Daniela Amodei, Anthropic se ha posicionado como una compañía pionera en el manejo responsable de la IA.

Recientemente, la compañía contrató al investigador Kyle Fish con el objetivo de desarrollar métodos para que los usuarios interactúen con la IA de manera ética o pensando en el bienestar de los sistemas de inteligencia artificial, como si se tratara de un ser consciente. Esta incorporación refleja que estas empresas están empezando a lidiar con preguntas sobre si los sistemas de IA futuros podrían merecer una consideración moral, y anticipando escenarios complejos que podrían surgir en un futuro próximo.” señaló Gustavo Guaragna, CEO de Snoop Consulting, firma especializada en transformación digital.

Actualmente, la investigación sobre la conciencia en la IA no ha encontrado pruebas concluyentes de que las máquinas puedan llegar a ser conscientes, pero tampoco se ha demostrado que esto sea imposible. Investigadores en el campo, como los pioneros en IA Joshua Bengio y Geoffrey Hinton, han explorado este concepto y subrayan que la conciencia es extremadamente difícil de medir, incluso en el ser humano. Esto significa que, aunque no haya una certeza científica sobre el potencial de conciencia en la IA, el avance en modelos cada vez más sofisticados y generalistas abre una incógnita que debe ser considerada desde un enfoque ético y preventivo.

Por Marcela Ernst